Algoritmaların Gölgesinde İletişim: Yapay Zekâ, İnsan ve Anlam Arayışı

-Aslı Şen, Melisa Güven

Yapay zekâ sadece bir araç mı yoksa iletişimin yeni bir aktörü mü? Dijital dönüşüm, akademik üretimden günlük yaşama kadar her alanı şekillendirirken, insan ve makine arasındaki ilişki nasıl evriliyor? Dr. Öğr. Üyesi Elif Karakoç Keskin ile yapay zekânın iletişim süreçlerine etkilerini, etik sorunlarını ve gelecekteki rolünü konuştuk.

Melisa Güven: Elif Hocam öncelikle hoş geldiniz. Sizi tanıyarak başlamak isteriz.

Elif Karakoç Keskin: Elbette. Merhabalar, hoş buldum. Ben Doktor Öğretim Üyesi Elif Karakoç Keskin. Yeditepe Üniversitesi İletişim Fakültesi Dekan Yardımcısıyım ve Radyo, Televizyon ve Sinema Bölümü öğretim üyesiyim. Aynı zamanda da Yapay Zekâ Politikaları Derneği’nde (AIPA) Medya ve İletişim Komisyonu Başkan Yardımcısıyım. Yeni medya, dijital iletişim, insan ve makine iletişimi gibi çalışma alanlarında akademik yayın ve faaliyetlerimi sürdürüyorum.

M.G: İletişim alanında çalışmalar yapan bir akademisyensiniz aynı zamanda. Son yıllarda yapay zekâ ile ilgili gelişmeleri nasıl değerlendiriyorsunuz? Yapay zekânın akademik alana etkilerini sormak isteriz.

E.K.K: Tabii, aslında pek çok etkiden bahsedebiliriz. Fakat benim aklıma ilk olarak bilimsel yayıncılık sürecinde bilgiye erişim noktasındaki etkileri geliyor. Çünkü artık akademi hiç olmadığı kadar hızlı bir bilimsel metin üretme, düzenleme ve dil bariyerine takılmadan bu süreci yönetebilme seviyesinde. Araştırma sürecinin en temel parçalarından olan; literatür tarama, ulaşma, üretme, özetleme hatta yazma noktasında yapay zekâ alternatifleri bulunmakta. Sadece literatürü araştırırken değil, veri analiz sürecinde de yapay zekâ araçlarından söz etmek mümkün. Akademik anlamda bilimsel yayın üretim sürecindeki o rutin görevler neredeyse tamamen otomatize hale gelmeye başladı. Bununla bağlantılı olarak son yıllarda öğrenme ve öğretme süreçlerinde yapay zekâ ile ilişkili metotlar kullanıldığını görmekteyiz. Ders içeriklerinin, materyallerinin oluşturulması akla gelen ilk örneklerden birkaçı. Bunlar akademide hızlı üretim açısından faydalanılabilir yönleri. Bu olumlu yönlerin beraberinde getirdiği bazı olumsuz taraflar da mevcut. Akademik üretimi hızlandırıyor, ancak intihal sorunu başlıyor. Akademik dürüstlük ihlal ediliyor ve yeni araştırma alanları, yeni araştırma konuları getiriyor; “Yapay Zekâ Etiği” gibi. İletişim alanında yeni bir iletişim kategorisi var artık: “Makinelerle iletişim” ya da “İnsan-makine iletişimi”. Bu iletişim kategorisini yaratan şey ne? Klasik iletişim sürecinin dönüşüme uğraması. Nasıl dönüşüme uğruyor? Nedir klasik iletişim süreci? Bir gönderici vardır, bir de alıcı. Birbirlerine mesaj gönderirler ve aslında bir anlam üretirler. Çünkü iletişim bir anlam üretme işidir. Biz burada teknolojiyi mesajların gönderilmesine aracı olarak konumlandırıyorduk. Fakat bugün kullandığımız ChatGPT gibi, diyalog kurduğumuz iletişimsel yapay zekâ araçları ile anlam üretme süreci bireyler ile makineler arasında gerçekleşmeye başladı. Dolayısıyla “Yapay zekâ sadece bir araç değil de iletişimin aktif bir katılımcısı haline mi geldi?” gibi sorular, akademide üzerinde durduğumuz yeni alanlar ve yeni araştırma konuları haline gelmiş durumda. Hem riskler hem fırsatlar açısından çok çeşitli etkilerden söz etmemiz mümkün.

Umut Yiğit: İletişim fakülteleri genelde mesaj üretme ve ileti tasarımı üzerinden ilerliyor. Bir taraftan da televizyondan beridir araç olmaları tartışılıyor. Bence yapay zekâ araç konumunda fakat bir geri bildirim alma durumu söz konusu. Sizce iletişim sürecinde yapay zekâ nerede konumlanıyor?

E.K.K: Çok farklı yaklaşımlar bulunmakta. Ama uzun yıllardır “insan ve makine iletişimi” dediğimiz bir kategorinin var olduğundan söz edebiliriz. İletişim kurduğumuz makine ile aslında gerçek bir dünya etkileşimi kurmuyoruz; tamamen sanal bir etkileşim. Ama o sanal iletişimde de bir anlam üretme süreci söz konusu. Dolayısıyla makinelerle yeni bir iletişim kategorisinin var olduğunu söyleyen araştırmacılar, bu fikre katılıyorlar. Yani artık makinenin (yapay zekânın), iletişim sürecinin gerçek katılımcısı (birey) tarafından bir aktör olarak konumlandığını söylüyorlar.

U.Y: Yani paradigma değişti.

E.K.K: Aynen öyle. Yani o iletişim sürecinin değiştiği yönünde fikir beyan eden araştırmacılar var.

U.Y: O zaman orada da yeni bir çatışma türeyecek.

E.K.K: Bizim için yeni bir tartışma alanı, daha doğrusu yeni araştırma konuları doğuran bir süreç. Elbette özü itibariyle bu makinenin bir bilinci yok, empati yapamaz. Biz onunla duygusal bir etkileşim kuramayız. İnsani değerlerden yoksun bir makine. Ancak gerçekleştirilen bazı araştırmalar, o iletişimsel yapay zekâyı kullanan bireylerin kurdukları etkileşimden tatmin oldukları ve hatta bu etkileşimi gerçek dünya etkileşimine tercih ettiğini bildiren sonuçlar var.

Aslı Şen: Hocam aslında sizler yapay zekâyı akademide literatür araştırması gibi sebepler ile kullanmaktasınız. Ben ve lisans eğitimi gören birçok öğrenci arkadaşım, ChatCPT gibi sohbet botlarını kullanmaktayız. Öğrencilerin kendilerini gösterebileceği bir alan olan proje ve sınav gibi önemli süreçlerde yapay zekâyı kullanmalarının olumlu veya olumsuz yönleri nelerdir? Öğrenciler tarafından fazlaca kullanılması hakkında ne düşünüyorsunuz?

E.K.K: Ben kullanılması taraftarıyım. Yani daha doğrusu kullanılmasının karşıtı değilim. Kendimden örnek vereyim. Nasıl yaklaşıyorum bu duruma ve öğrencilerimin nasıl yaklaşmasını istiyorum: Önce herhangi bir konu hakkında ChatGPT’ye essay yazdırmalarını istiyorum. Daha sonra bu yazıları sınıfa getiriyorlar ve üzerine tartışıyoruz. Biliyorsunuz, iletişimciler olarak hikâye üretme, yaratma kısmında da varız. Bizim yaratıcı ve özgün içerikler ortaya koymamız lazım. Dolayısıyla bu tartışma ortamı sınıfta yaratıldıkça aslında öğrenciler, ChatGPT’nin verdiği metinlerin özgün olmadığını ve öğrenilmiş kalıplarla o metni oluşturduğunu görmeye başlıyor. Örneğin, bir senaryo yazdırmalarını istiyorum.

Çünkü çok temel, basit fikirlerle yazıyor. Anlam üretme, duygusal etkileşim, kültürle beslenme ve benzeri yetilere sahip değil. Böyle olunca öğrenciler bunu görebiliyor. Bunun yanı sıra çok rutin işler varsa onları da yaptırmalarını söylüyorum. Sunum Becerileri dersinde özellikle yapay zekâya yaptırmalarını istiyorum. Ama o metnin içeriği, anlatımı, sınıfta tartışılması tamamen onlara ait. Kısacası yardımcı olacak işleri, operasyonel işleri hızlandırmak için kullanabiliyorlar. Fakat daha çok tartışma, sözel olarak ifade etme, fikir üretme, eleştirme işine daha fazla ağırlık verdiğimi söyleyebilirim ki bence zaten buna ihtiyacımız var. Artık metin yazmak çok kolay. Ama o metni anlatabilme becerisi, o fikri ifade edebilme becerisi çok daha önem kazanmış durumda. Ben de derslerimde bu alanı daha fazla artırdım diyebilirim.

U.Y: Yani bir özne olarak o etkileşim sürecine bağlı olmasını sağlıyorsunuz.

E.K.K: Çünkü kontrol mekanizması sensin aslında, o değil. Yapay zekânın zaten risklerinin temelinde bir karar mekanizması olarak işlemesi var. Yani kişinin artık kendi karar yetkisini algoritmalara bırakma süreci var. Bizim amacımız bunu değiştirmek. Karar mekanizması sensin, kontrol mekanizması sensin. Onu sadece bir araç olarak kullanman gerekiyor. Oradan aldığın metni bana aynen getiremezsin. O yüzden kaçınmaktansa birlikte etkileşim halinde üretimi gerçekleştirmelerini sağlamak daha doğru geliyor.

M.G: Ekonomi, eğitim, hukuk ve insan hakları, afet yönetimi, sağlık gibi pek çok alanda yapay zekânın geliştiğini görüyoruz. Bu konular hakkında neler düşünüyorsunuz? Sizce bize gelecekte ne tür fırsatlar yaratabilir ya da hangi risklerle karşı karşıya kalabiliriz?

E.K.K: Bahsettiğiniz tüm alanlarda çok kapsamlı fırsatlar var. Mesela, sağlık alanında hastalıkların hızlı teşhis edilmesi ya da kişilere özel tedavi yöntemlerinin bulunması. Eğitimde yine bu kişiselleştirme durumu son derece önemli. Her öğrencinin ihtiyacına göre kişiselleştirme metotları kullanılması gündemde. Hukukta, belgelerin okunması, analizi, hatta belki de davaların takibi noktasında verimli olabilir. Ekonomide de yine, sektörün verimliliğini artıracak yenilikçi çözümler sunabilir. Afet yönetiminde, afet öncesi, sırası ve sonrasında o yönetimsel süreçte kaynakların hızlı kullanımı noktasında etkili olabilir.

Bunlar yarattığı fırsatlar. Ama bu faydalanabilir yönlerin dışında bir takım riskler de var. Gündemde en çok yer kaplayan konu ise şu: Yapay zekâ işsizlik oranını artıracak, insanları işsiz bırakacak. Yıllar geçtikçe bu gündem durulmaya başladı. Çünkü insanlar şunu fark etmeye başladılar: Yapay zekâ sadece insanları işsiz bırakmakla kalmayacak; insan hakları, eşitsizlikler, insani değerler gibi bir takım sorunları daha da derinleştirecek. Nedir bu sorunların kaynağı? Algoritmalar. Yapay zekâyı oluşturan algoritmalar yanlı sonuçlar doğurabiliyor, önyargıları yeniden üretebiliyorlar. Bunun oluşmasının temel sebebi yapay zekânın çalışma prensibi. Yapay zekâ makine öğrenmesi denen bir prensiple çalışıyor. Veri setlerinden öğrenerek bir çıktı veriyor. Peki bu veri ne? Veri her şey aslında. Bizim kişisel verilerimiz, sosyal medyadaki dijital izlerimiz, bir ekranı görüntüleme süremiz ve benzeri gibi. ChatGPT’nin son versiyonun duyurulması ile birlikle bir yapay zekâ uygulamaları üretimi furyası ortaya çıktı. Neden bu kadar fazla var? Çünkü, milyarlarca internet kullanıcısı var ve bu milyarlarca internet kullanıcısının milyarlarca veri sirkülasyonu var. Dolayısıyla yapay zekânın besleneceği çok fazla veri bulunmakta. Bu veriler ile beslenme durumu da yanlılık noktasında son derece önemli. Eğer herhangi bir yapay zekânın eğitildiği veri seti bir takım yanlı gruplardan beslenirse, eğitim verisi sorunlu olduğundan yapay zekânın sunduğu çıktılar da sorunlu olacak. En bilinen örneklerden bir tanesi Amazon’un işe alım uygulaması. Çok fazla başvuru olduğundan işe alımlar için CV’leri analiz edecek bir yapay zekâ üretiyor. Fakat bu yapay zekânın eğitim verisi daha çok erkek adayların CV’leriyle eğitildiğinden, kadın adayların CV’leri daha düşük puan alıyor ya da onları görmezden geliyor. Haliyle tepkiler gelmeye başlıyor ve yanlış sonuçlar nedeniyle bu yapay zekâ uygulaması ortadan kaldırılıyor. Bir de, o makine öğrenmesi sürekli devam eden bir süreç. ChatGPT’ye bir prompt girdiğimizde onu eğitmeye devam ediyoruz. Bu cinsiyet ya da farklı ötekileştirme durumlarında gördüğümüz temsil sorunları, yapay zekâyı geliştirenin önyargılarını taşıyor. İnsan müdahalesi sorunsalı.

Biz bugün algoritmalar üzerinden bunu tartışıyoruz ama insanın kendisi zaten önyargılara sahip bir varlık. Peki nasıl çözebiliriz bu durumu? Farkındalığı sağlamak, yani önyargılı sonuçlar elde edeceğini bile bile o yapay zekâyı kullanmamak, uzak durmak ya da algoritma geliştiricilerin bu konuda daha sorumlu ve daha etik davranmaları için bir takım regülasyonlara yol açacak regülasyonlara yönlendiren çalışmalar yapmak önemli.

Cem Çalışkan: Algoritma geliştiricilerinin önyargıları asıl problem gibi görünüyor. Çok demokratik bir algoritma geliştiricisi düşünelim. Eşcinsellik hastalıktır gibi bir veri seti girilirse, yine çoğunlukçu normali üretme riski taşımaz mı?

E.K.K: Bu tartışma Siri, Alexa, Google Assistant gibi sanal asistanlarla başladı aslında. Hepsinde kullanılan ses bir kadına ait. Bir çalışma görmüştüm ve katılımcılara “Alexa’yı hayal edin” diyorlardı. Tüm fikirler alındıktan sonra, toplumda idealize edilmiş bütün güzellik anlayışlarının hepsi Alexa’da toplandığı görülmüş. Kadının aslında güven veren bir varlık olduğunu ve kullanıcılar tarafından verilen görevleri yerine getirmesi için harika bir çerçeve sunduğu gibi argümanlarla toplumsal cinsiyet kodlarını yeniden ürettiğine yönelik bir takım tatışmalar bulunmakta.

Bu da literatürde yeni düşünceler doğurdu: Queer yapay zekâlar ve sanal asistanlar olabilir mi? Danimarka’da bir reklam ajansı bununla ilgili çalışma yapıyor. Queer yani cinsiyetsiz bir yapay zekâ geliştiriyorlar. Kadın ve erkek seslerini birleştirerek, cinsiyeti olmayan bir ses ortaya çıkarıyorlar. Ürettikleri sanal asistanı Apple Store, Google Play Store’da kullanıcılara sunuyorlar. Fakat o kadar az talep görüyor ki bir süre sonra bu sanal asistanı kaldırmak zorunda kalıyorlar. Toplum zaten o kodlara o kadar entegre ki navigasyonu tarif eden bir kadın olması onu rahatsız etmiyor. Sanal asistanların tartışma yaratmasının nedeni de o dönem bu tür yapay zekâ araçlarını geliştiren kişilerin ağırlık olarak toplumsal cinsiyet kodlarını benimseyen erkekler olmasıydı. Sonrasında kadın kodlayıcıların sayıları arttı.

Fakat yapay zekânın geliştirilmesi noktasında; çok demokratik, cinsiyetçi kodlardan ve ötekileştirici yaklaşımlardan uzak duran biri bile olsa, neye talep varsa ona yönelmek durumunda kalıyor. Çünkü ekosistemde platform kapitalizmi var. Onu gerçekleştirmek zorunda. Kendi bağımsız bir yapay zekâ geliştiriyorsa o demokratik ve eşitlikçi düşünce yapısını kendi algoritmalarına yansıtabilir. Ama o noktada da işi kimin yönettiği, nereye yapıldığı önemli.

M.G: Yapay zekâ birçok alanda çeşitli fırsatlar sunmakta. Peki bu konuda sivil toplum kuruluşlarının nasıl bir rolü olduğunu düşünüyorsunuz?

E.K.K: Açıkçası çok önemli buluyorum. Yapay zekânın fırsatları ve riskleri hakkında toplumun pek çok kesiminin faydalanabilmesi ve bilinçlendirilmesi alanında çalışmalar yapabilirler.

Bununla da kalmayıp, üniversitelerle, özel sektörle, başka sivil toplum kuruluşlarıyla, kamu kurumlarıyla iş birliği yaparak, bir takım çalışmalar yürüterek yapay zekâ ile ilişkili kamu politikalarının geliştirilmesine katkı sağlama potansiyeline sahipler.

M.G: Üyesi olduğunuz Yapay Zekâ Politikaları Derneği (AIPA) bu konuda söz ettiğimiz faaliyetleri gösteren ilk kuruluşlardan biri. Bize biraz AIPA’dan bahsedebilir misiniz?

E.K.K: Tabi, sizin de bahsettiğiniz gibi AIPA, Yapay Zekâ Politikaları Derneği. Türkiye’de yapay zekâ konusunda faaliyet göstermek üzere kurulmuş ilk sivil toplum kuruluşlarından bir tanesi. Bu alanda 2021 yılından beri faaliyet gösteriyor. AIPA’nın kuruluş amaçlarından bahsedecek olursak; Türk toplumunu yapay zekâ ile ilgili bilinçlendirmek, yapay zekâya yönelik farkındalık kazandırmak. Aynı zamanda üniversite, özel sektör, diğer sivil toplum kuruluşları ve kamu kurumlarıyla ortaklıklar kurup çalışmalar gerçekleştirerek yapay zekânın gelişimine ve kamu politikalarının geliştirilmesine katkı sağlamak temel amaçları arasında. Bu alanda pek çok çalışma gerçekleştirildi. Seksenin üzerinde Tomorrow Meetings yapıldı, yetmişin üzerinde Tomorrow Talks yapıldı. Geçtiğimiz Kasım ayında RTÜK Birliği’nde büyük bir Yeni Medya Zirvesi gerçekleştirildi. Uluslararası yapay zekâ alanında medya zirvesi ve birden fazla oturumda yapay zekâ ile ilgili pek çok konu tartışıldı, değerlendirildi. Bunun dışında, AIPA bilimsel araştırmalara da çok önem veren bir dernek. Örneğin, 2021 yılından beri ulusal ve uluslararası nitelikte dört tane kitap yayınlandı. Yine yakın zamanda “International Journal on AI” adında AIPA’ın uluslararası hakemli dergisi yayın hayatına başladı. Sivil toplum kuruluşlarının gerçekleştirdiği politika belgeleri yayımlamak da önemli faaliyetlerden bir tanesi. Ben Medya ve İletişim Komisyonu üyesiyim. Dernek başkanımız Zafer Küçükşabanoğlu ve bizim komisyon başkanımız

Doç. Dr. Derya Gül Ünlü’nün planları dahilinde politika belgesi hazırlanması gündemde. Medya ve iletişim çalışmaları için oldukça önemli bir adım. Bizim komisyonumuz dışında yirmiye yakın çalışma alanı var. Ekonomiden göçe, hukuktan güvenlik ve dış politikaya uzanan; alanında uzman, akademisyenlerin ve sektör temsilcilerinin bulunduğu komisyonlar var ve her bir alanda çeşitli çalışmalar sürdürülmekte.

A.Ş: Peki AIPA, Türkiye ekosistemine ne tür katkılar sağlıyor?

E.K.K: Yapay zekâ ekosistemi açısından, AIPA gibi diğer sivil toplum kuruluşlarının da faaliyetleri aslında çok önemli. RTÜK’le birlikte yapılan zirveye, hem Türkiye’den hem de dünyanın çeşitli ülkelerinden akademisyenler katıldı. Burada sıkça eleştirdiğimiz veri toplama süreçlerinde aktif rol oynayan, kişisel verilerimizi toplayarak bize geri satan ya da sosyal medya ve dijital platformlarda kalmamız için sürekli içerikler pompalayan; Netflix, BluTV, Exxen, gibi platformların temsilcileri ile istişare etme fırsatı bulduk. Risk olarak tanımladığımız şeylerin ne olduğunu aktarma şansı bulduk ve neler yapılabilir diye konuştuk. Yine RTÜK’ün, Türkiye genelinde yaptığı Yapay Zekâ Farkındalığı araştırması kamuoyuyla ilk defa paylaşıldı. Araştırmadaki farkındalık düzeyleri bize gerçekten bu konu ile ilgili toplumda yapay zekâ okuryazarlığı hakkında çalışmalar yapmamız gerektiğini gösterdi ve bunu sadece eğitimciler yapamaz. Sektörden, sivil toplumdan, kamu kurumlarından paydaşlara ihtiyacımız var. Medya ve iletişim araçlarına yerel ve ulusal farkındalığı, yapay zekâ okuryazarlık bilincini artırabilmemiz için de ihtiyacımız var. Bu alanda ortaklıklar kurulması açısından adımlar atıldı. Geçen gün Resmi Gazete’de gördüm. Mecliste yapay zekâ araştırma komisyonu kuruldu. Bizim gerçekten ülke olarak çok daha fazla şey yapmamız gerekiyor diyebilirim. Bu önemli bir adım.

M.G: Yapay zekânın gelişmesi ile birlikte hayatımızda da birçok şey değişiyor. Chatbotları giderek daha sık kullanmaya ve onlarla daha derin etkileşimler kurmaya başlıyoruz. Bir süre önce “Yapay zekâ ilk kurşunu sıktı!” başlıklı haberler görmüştük. Yapay zekâ ile etkileşimin artması bir yalnızlaşma durumunu da beraberinde getirecek mi?

E.K.K: Yapay zekâ ile kurduğumuz iletişimde, aslında temel amaç fayda sağlamak. İşlerimizi daha hızlı yapmamızı, fikir almamızı sağlıyor ve bize bir konfor alanı yaratıyor. Ve dolayısıyla bizim o konfor alanında çok daha hızlı karar vermemizi kolaylaştırıyor. Sosyal bir izolasyona neden olur mu yapay zekâ? Evet, olabilir. Fakat insan, tabiatı itibariyle gerçek sosyal etkileşime ihtiyaç duyar. Yapay zekâyı işlerini gerçekleştirmek için bir araç olarak kullansa da bu durum insanları tamamen yalnızlığa itmez. Ama bence buradaki yalnızlaşmaktan öte en önemli risk bu sohbet robotlarının yani iletişimsel yapay zekânın çok fazla kullanılmasının, öz yeterlik ve bağımsız düşünme gibi noktalarda risk yaratıyor olması. Yapay zekâ birçok iş için kullanılıyor. Örneğin, mail atarken ChatGPT’ye yazdırmak, bir makaleyi ona yazdırmak, arkadaşınıza çok dağınık bir mesaj yazdınız, toplanması için yine yardım almak. Bir noktada artık bireyin gölgesi gibi hareket eder hale geldiği için öz yeterliliği, bağımsız düşünmeyi etkilediğini düşünüyorum. Bana göre yalnızlaşmaktan ziyade bence daha riskli olan şey bu.

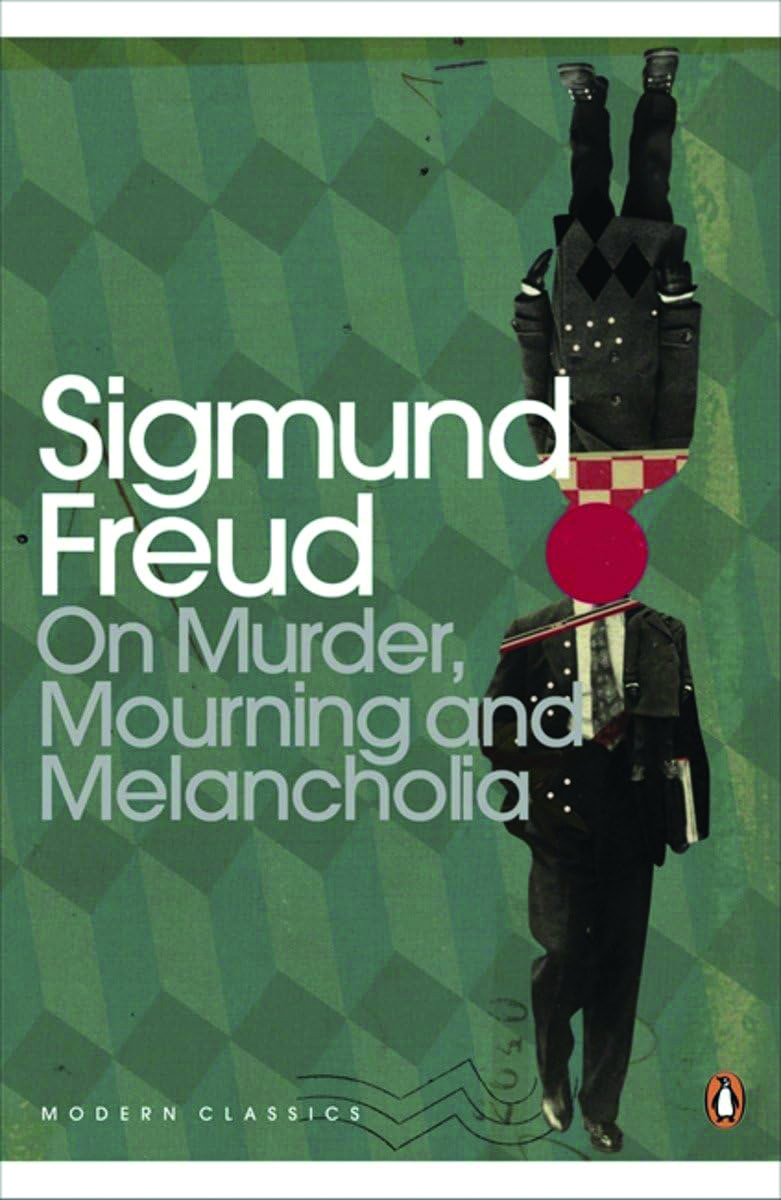

A.Ş: “Yas ve Melankolide Sanal Gerçekliğin Duygusal Boyutu” başlıklı makalenizden bir soru sormak istiyorum. Bir annenin hayatını kaybeden kızı ile sanal gerçeklik aracılığıyla tekrardan buluşması ve bir gün boyunca zaman geçirmesini, Freud’un yas ve melankoli teorisi üzerinden ele alıyorsunuz. Bizler yıllar geçtikçe yapay zekâ üretimi çıktıların, VR teknolojilerinin gerçekçiliğinin arttığını görmekteyiz. Yapay zekânın ve sanal gerçeklik teknolojilerinin gelişmesi duygusal ve gerçeklik algısında bir bozulmaya yol açıyor mu, toplumsal etkileri nasıl oluyor?

E.K.K: Sanal gerçeklik üzerine çalışan bir ajans, yıllar önce kızını kaybetmiş bir anne ile kızını tekrar buluşturabileceklerini söylüyorlar. Kızı bugün yaşasaydı nasıl görünürdü gibi ayrıntılar üzerinde çalışıyorlar ve VR gözlüğü ile anne ve kızı buluşturuyorlar. Freud şunu söylüyor: “Yas dediğimiz şey yaşanıp biten bir süreçtir. Eğer yas tekrar edilirse ya da bitmezse o zaman patolojik bir evre olan melankoliye girer.” Melankoli yastan çok daha uzun bir süreçtir ve bireyin gündelik hayatına devam etmesini derinden etkileyen bir durumdur. Burada teknoloji ile bireyin kaybının yeniden yaşatılması ve yas sürecinin tekrar canlandırması söz konusu. Kısa vadede, ChatGPT’den bir metin almak gibi konfor alanı yaratabilir. O sevgiyi belki tekrar hissedeceksin ama aslında onun hayatta olmadığıyla tekrardan yüzleştiğinde, duygusal manipülasyonla da yüzleşmiş olacaksın.

A.Ş: “Oyun mu İş mi? Youtube Kidfluencerları Üzerine Karşılaştırmalı Bir Analiz” adlı makaleniz de çok etkileyiciydi. Çocukların korunması açısından sosyal medyada büyük bir açık söz konusu. Bu çocukların dijital ortamlarda çocuk işçi rolüne büründürülmesi hakkında ne düşünüyorsunuz?

E.K.K: Kidfluencer demek çocuk ünlü demek. Bu çocuklar ebeveynleri tarafından veri ekosistemine sunulan canlılar haline gelmiş durumda. Mahremiyeti sergileniyor, unutulma hakları tamamen gözardı edilerek gündelik hayatları paylaşılıyor. Bu konuda benim için yas ve melankolide olduğu gibi bir sorunsaldan yola çıktı. Çünkü durum bir çeşit dijital çocuk işçiliği formu. Makalede örneklemlerimden biri, Türkiye’de en fazla kazanan çocuk influencer olan Prenses Elif kanalına dairdi. Her gün içerik yayınlıyor. Bu bloglardan bazılarında Elif kırk derece ateşli ama içerik üretmesi gerektiği için o halde çekiliyor. Elif duş alırken, çizgi film izlerken, ders çalışırken yani bütün günlük hayat rutini çocuğun ebeveynleri tarafından sosyal medyaya sunuluyor. Buna da “sharenting” deniliyor. Çocukların dijital reşitlik yaşı var. BTK’ya göre bu yaş on üç. Bu yaşın altındaki çocukların hesapları ebeveynleri tarafından yürütülüyor. Prenses Elif’in anne ve babasının yaptığı röportajlarda şunları okudum: “Biz çok memnunuz, evimizi, arabamızı aldık, tatillere gidiyoruz. Elif de bu durumdan çok mutlu.” Ama küçük kızın bir karar mekanizması yok, onun sorumluluğu sana ait. Dolayısıyla temel tartışma influencer olan çocukların, dijital platform kapitalizminin olduğu alana dahil edilmesi oluyor.

Kidfluencer ile ilgili bir başka makale daha yazmıştım. Bu kez orada Postman’ın “Minyatür Yetişkinlik” kavramından ilerledim. Ne yazık ki daha önce de konuştuğumuz, toplumun bir takım güzellik standartlarına yönelik beklentileri bu alanda da mevcut. Sosyal medyanın sunduğu bu çerçeve, çocuklar için de bir takım güzellik standartlarını gerektiyor biliyor musunuz? Sekiz, dokuz yaşındaki çocuklara takma tırnaklar takılıyor. Leopar desenli kıyafetler giydiriliyor. Yani minyatür yetişkin formuna sokuluyorlar. Postman 90’larda televizyon reklamları üzerinden söylüyor bunu. Bugün o kavram, platform kapitalizmine ve ekosisteminde minyatür yetişkinliklerden söz etmemize neden oluyor. Böyle bir dönüşüm içerisindeyiz. Bence bu gelinen nokta çok daha tehlikeli bir boyuta ulaşmış durumda diye düşünüyorum.

U.Y: Hocam bakış açınızı çok sevdim. Tamam problem var ama umut da var, demek çözümün öncülü oluyor sonuçta.

E.K.K: Rica ediyorum hocam, şöyle bir durum var: Bu sorunlar oldukça yapısal ve bizim çözebileceğimiz türden değil. Bunun farkındayım. Ancak iletişim süreçlerinde hep söylediğim bir şey var: Etkili iletişim kurmak istiyorsanız, hem içsel hem de bireysel olarak şunu aklımızda tutmalıyız: Önyargılarımızı kontrol edebilmek ve onlarla mücadele edebilmek için önce kendimizi kontrol etmemiz gerekiyor. Kendimizin farkında olabilmemiz için insanlarla kurduğumuz ilişkilerin, dijital süreçlerde kurduğumuz bağların ya da makinelerle olan ilişkilerimizin farkında olmak zorundayız. Mervin Minsky’nin bir sözünü çok seviyorum. Kendisi bir bilgisayar bilimci ve yapay zekâ çalışmalarına büyük katkıları olmuş bir isim. Yıllar önce şöyle bir şey söylemiş: “Hiçbir bilgisayar, ne yaptığının farkında olarak tasarlanmadı. Ama biz de kimi zaman ne yaptığımızın farkında olmuyoruz.” Fakat biz, yapay zekânın aksine bilince sahip canlılar olarak farkındalık geliştirebilecek varlıklarız. Bu yüzden önceliğimiz, bireysel değerlerimiz olmalı. Sonrasında ise insanlarla kurduğumuz iletişimdeki değerler. Duygusal etkileşimler, gerçek dünya bağları, empati, şeffaflık… Algoritmalar ve yapay zekâ ile ilgili en çok tartıştığımız şey de bu değil mi? Hesap verebilirlik, şeffaflık bunların yoksunluğu. Dolayısıyla biz, eğer bu değerleri hayatımızda önceler, farkındalıkla yaşar ve kendimizden başlayarak çevremizdekilere bu anlayışı entegre etmeye çalışırsak, kurduğumuz ilişkilerde anlamlı bir şeyler yapıyor olduğumuzu hissedebiliriz. Örneğin, “Ben, beni duygusal olarak manipüle edecek ya da yasımı tekrar yaşatacak bir aracı kullanmak istemiyorum. Bunu reddediyorum.” diyorsak bu da bir farkındalıktır.

A.Ş: Hocam bize çok değerli bilgiler kattınız. Geldiğiniz için çok teşekkür ederiz…

E-Bülten Kaydı

Gelişmelerden haberdar olun.